数据挖掘中所需的概率论与数理统计知识、上

数据挖掘中所需的概率论与数理统计知识、上(关键词:微积分、概率分布、数理统计简史、正态分布、期望、方差、协方差、大数定律、中心极限定理)

一个月余前,在微博上感慨道,不知日后是否有无机会搞DM,微博上的朋友只看不发的围脖评论道:算法研究领域,那里要的是数学,你可以深入学习数学,将算法普及当兴趣。想想,甚合我意。自此,便从rickjin写的“正态分布的前世今生”开始研习数学。

如之前微博上所说,“今年5月接触DM,循序学习决策树.贝叶斯,SVM.KNN,感数学功底不足,遂补数学,从‘正态分布的前后今生’中感到数学史有趣,故买本微积分概念发展史读,在叹服前人伟大的创造之余,感微积分概念模糊,复习高等数学上册,完后学概率论与数理统计,感概道:微积分是概数统计基础,概数统计则是DM&ML之必修课。”包括读者相信也已经感觉到,我在写这个Top 10 Algorithms in Data Mining系列的时候,其中涉及到诸多的数学概念与基础知识(例如此篇SVM文章内诸多max.s.t.对偶.KKT条件.拉格朗日.松弛因子等问题则皆属于数学内一分支:最优化理论与算法范畴内),特别是概率论与数理统计部分。更进一步,在写上一篇文章的时候,看到机器学习中那么多距离度量的表示法,发现连最起码的期望,方差,标准差等基本概念都甚感模糊,于此,便深感数学之重要性。

很快,我便买了一本高等教育出版社出版的概率论与数理统计一书,此书“从0-1分布、到二项分布、正态分布,概率密度函数,从期望到方差、标准差、协方差,中心极限定理,样本和抽样,从最大似然估计量到各种置信区间,从方差分析到回归分析,bootstrap方法,最后到马尔可夫链,以前在学校没开概率论与数理统计这门课,现在有的学有的看了”。且人类发明计算机,是为了辅助人类解决现实生活中遇到的问题,然计算机科学毕竟只发展了数十年,可在数学.统计学中,诸多现实生活问题已经思考了数百年甚至上千年,故,计算机若想更好的服务人类解决问题,须有效借鉴或参考数学.统计学。世间万事万物,究其本质乃数学,于变化莫测中寻其规律谓之统计学。

话休絮烦。本文结合高数上下册等书、微积分概念发展史,概率论与数理统计、数理统计学简史等书(此文亦可看作此些书的读书笔记)与wikipedia,对数据挖掘中所需的概率论与数理统计相关知识概念作个科普,方便你我随时查看复习相关概念,而欲深入学习研究的课后还需参看相关专业书籍.资料。同时,本文篇幅会比较长,简单来说:

- 第一节讲概念:微积分中极限、导数,微分、积分;第二节讲概念:关于随机变量及其分布;第二节讲历史:从数理统计学简史中窥探正态分布的前后由来;第四节继续讲概念:关于数学期望.方差等。

4部分起承转合,彼此依托。且在本文中,会出现诸多并不友好的大量各种公式,但基本的概念.定理是任何复杂问题的根基,所以,你我都有必要硬着头皮好好细细阅读。最后,本文若有任何问题或错误,恳请广大读者朋友们不吝批评指正,谢谢。

开头前言说,微积分是概数统计基础,概数统计则是DM&ML之必修课”,是有一定根据的,包括后续数理统计当中,如正态分布的概率密度函数中用到了相关定积分的知识,包括最小二乘法问题的相关探讨求证都用到了求偏导数的等概念,这些都是跟微积分相关的知识。故咱们第一节先复习下微积分的相关基本概念。

事实上,古代数学中,单单无穷小、无穷大的概念就讨论了近200年,而后才由无限发展到极限的概念。

1.1、极限极限又分为两部分:数列的极限和函数的极限。

1.1.1、数列的极限 定义 如果数列{xn}与常a 有下列关系:对于任意给定的正数e (不论它多么小), 总存在正整数N , 使得对于n >N 时的一切xn, 不等式 |xn-a |<e都成立, 则称常数a 是数列{xn}的极限, 或者称数列{xn}收敛于a , 记为 或

或

也就是说,

设函数f(x)在点x0的某一去心邻域内有定义. 如果存在常数A, 对于任意给定的正数e (不论它多么小), 总存在正数d, 使得当x满足不等式0<|x-x0|<d 时, 对应的函数值f(x)都满足不等式 |f(x)-A|<e , 那么常数A就叫做函数f(x)时 的极限, 记为

的极限, 记为

也就是说,

几乎没有一门新的数学分支是某个人单独的成果,如笛卡儿和费马的解析几何不仅仅是他们两人研究的成果,而是若干数学思潮在16世纪和17世纪汇合的产物,是由许许多多的学者共同努力而成。

甚至微积分的发展也不是牛顿与莱布尼茨两人之功。在17世纪下半叶,数学史上出现了无穷小的概念,而后才发展到极限,到后来的微积分的提出。然就算牛顿和莱布尼茨提出了微积分,但微积分的概念尚模糊不清,在牛顿和莱布尼茨之后,后续经过一个多世纪的发展,诸多学者的努力,才真正清晰了微积分的概念。

也就是说,从无穷小到极限,再到微积分定义的真正确立,经历了几代人几个世纪的努力,绝非仅牛顿与莱布尼茨两人之功,而课本上所呈现的永远只是冰山一角。

1.2、导数 设有定义域和取值都在实数域中的函数 在

在 取得增量

取得增量 处可导,并称这个极限为函数

处可导,并称这个极限为函数 处的导数,记为

处的导数,记为 也可记为: ,

, 或

或 。

。

变动到附近的

变动到附近的 相应于自变量增量

相应于自变量增量 的微分,记作

的微分,记作 ,即

,即 的线性主部。通常把自变量

的线性主部。通常把自变量 的增量

的增量

。1.4、积分 积分是微积分学与数学分析里的一个核心概念。通常分为定积分和不定积分两种。不定积分的定义 一个函数

。1.4、积分 积分是微积分学与数学分析里的一个核心概念。通常分为定积分和不定积分两种。不定积分的定义 一个函数 的不定积分,也称为原函数或反导数,是一个导数等于

的不定积分,也称为原函数或反导数,是一个导数等于 的函数

的函数

不定积分的有换元积分法,分部积分法等求法。定积分的定义 直观地说,对于一个给定的正实值函数

,

, 上的定积分

上的定积分定积分与不定积分区别在于不定积分便是不给定区间,也就是说,上式子中,积分符号没有a、b。下面,介绍定积分中值定理。 如果函数f(x)在闭区间[a,b]上连续, 则在积分区间[a,b]上至少存在一个点,

使下式成立:

使下式成立:牛顿-莱布尼茨公式 这个公式便叫积分中值公式。接下来,咱们讲介绍微积分学中最重要的一个公式:牛顿-莱布尼茨公式。 如果函数F (x)是连续函数f(x)在区间[a, b]上的一个原函数, 则

,此公式称为牛顿-莱布尼茨公式, 也称为微积分基本公式。这个公式由此便打通了原函数与定积分之间的联系,它表明:一个连续函数在区间[a, b]上的定积分等于它的任一个原函数在区间[a, b]上的增量,如此,便给定积分提供了一个有效而极为简单的计算方法,大大简化了定积分的计算手续。 下面,举个例子说明如何通过原函数求取定积分。如要计算

,此公式称为牛顿-莱布尼茨公式, 也称为微积分基本公式。这个公式由此便打通了原函数与定积分之间的联系,它表明:一个连续函数在区间[a, b]上的定积分等于它的任一个原函数在区间[a, b]上的增量,如此,便给定积分提供了一个有效而极为简单的计算方法,大大简化了定积分的计算手续。 下面,举个例子说明如何通过原函数求取定积分。如要计算 ,由于

,由于 是

是 的一个原函数,所以

的一个原函数,所以 。1.5、偏导数 对于二元函数z = f(x,y) 如果只有自变量x 变化,而自变量y固定 这时它就是x的一元函数,这函数对x的导数,就称为二元函数z = f(x,y)对于x的偏导数。

。1.5、偏导数 对于二元函数z = f(x,y) 如果只有自变量x 变化,而自变量y固定 这时它就是x的一元函数,这函数对x的导数,就称为二元函数z = f(x,y)对于x的偏导数。定义 设函数z = f(x,y)在点(x0,y0)的某一邻域内有定义,当y固定在y0而x在x0处有增量

,

,如果极限

存在,则称此极限为函数z = f(x,y)在点(x0,y0)处对 x 的偏导数,记作:

例如

。类似的,二元函数对y求偏导,则把x当做常量。

。类似的,二元函数对y求偏导,则把x当做常量。第二节、离散.连续.多维随机变量及其分布2.1、几个基本概念点

(一)样本空间

定义:随机试验E的所有结果构成的集合称为E的 样本空间,记为S={e},称S中的元素e为样本点,一个元素的单点集称为基本事件.

(二)条件概率

- 条件概率就是事件A在另外一个事件B已经发生条件下的发生概率。条件概率表示为P(A|B),读作“在B条件下A的概率”。联合概率表示两个事件共同发生的概率。A与B的联合概率表示为

或者

或者 。边缘概率是某个事件发生的概率。边缘概率是这样得到的:在联合概率中,把最终结果中不需要的那些事件合并成其事件的全概率而消失(对离散随机变量用求和得全概率,对连续随机变量用积分得全概率)。这称为边缘化(marginalization)。A的边缘概率表示为P(A),B的边缘概率表示为P(B)。

。边缘概率是某个事件发生的概率。边缘概率是这样得到的:在联合概率中,把最终结果中不需要的那些事件合并成其事件的全概率而消失(对离散随机变量用求和得全概率,对连续随机变量用积分得全概率)。这称为边缘化(marginalization)。A的边缘概率表示为P(A),B的边缘概率表示为P(B)。 有时候也称为后验概率。 同时,P(A|B)与P(B|A)的关系如下所示:

。

(三)全概率公式和贝叶斯公式

1、全概率公式 假设{ Bn : n = 1, 2, 3, ... } 是一个概率空间的有限或者可数无限的分割,且每个集合Bn是一个可测集合,则对任意事件A有全概率公式:又因为

所以,此处Pr(A | B)是B发生后A的条件概率,所以全概率公式又可写作:

在离散情况下,上述公式等于下面这个公式:

。但后者在连续情况下仍然成立:此处N是任意随机变量。这个公式还可以表达为:"A的先验概率等于A的后验概率的先验期望值。 2、贝叶斯公式 贝叶斯定理(Bayes' theorem),是概率论中的一个结果,它跟随机变量的条件概率以及边缘概率分布有关。在有些关于概率的解说中,贝叶斯定理(贝叶斯更新)能够告知我们如何利用新证据修改已有的看法。

。但后者在连续情况下仍然成立:此处N是任意随机变量。这个公式还可以表达为:"A的先验概率等于A的后验概率的先验期望值。 2、贝叶斯公式 贝叶斯定理(Bayes' theorem),是概率论中的一个结果,它跟随机变量的条件概率以及边缘概率分布有关。在有些关于概率的解说中,贝叶斯定理(贝叶斯更新)能够告知我们如何利用新证据修改已有的看法。通常,事件A在事件B(发生)的条件下的概率,与事件B在事件A的条件下的概率是不一样的;然而,这两者是有确定的关系,贝叶斯定理就是这种关系的陈述。 如此篇blog所述“据维基百科上的介绍,贝叶斯定理是关于随机事件A和B的条件概率和边缘概率的一则定理。

P(A)是A的先验概率或边缘概率。之所以称为"先验"是因它不考虑任何B方面的因素。P(A|B)是已知B发生后A的条件概率(直白来讲,就是先有B而后=>才有A),也由于得自B的取值而被称作A的后验概率。P(B|A)是已知A发生后B的条件概率(直白来讲,就是先有A而后=>才有B),也由于得自A的取值而被称作B的后验概率。P(B)是B的先验概率或边缘概率,也作标准化常量(normalized constant)。 按这些术语,Bayes定理可表述为:后验概率 = (相似度*先验概率)/标准化常量,也就是,后验概率与先验概率和相似度的乘积成正比。另外,比例P(B|A)/P(B)也有时被称作标准相似度(standardised likelihood),Bayes定理可表述为:后验概率 = 标准相似度*先验概率。” 综上,自此便有了一个问题,如何从从条件概率推导贝叶斯定理呢?

根据条件概率的定义,在事件B发生的条件下事件A发生的概率是

同样地,在事件A发生的条件下事件B发生的概率

整理与合并这两个方程式,我们可以找到

这个引理有时称作概率乘法规则。上式两边同除以P(B),若P(B)是非零的,我们可以得到贝叶斯 定理:

2.2、随机变量及其分布2.2.1、离散型随机变量的定义 定义:取值至多可数的随机变量为离散型的随机变量。概率分布(分布律)为

且

(一)(0-1)分布

若X的分布律为:同时,p+q=1,p>0,q>0,则则称X服从参数为p的0-1分布,或两点分布。 此外,(0-1)分布的分布律还可表示为:

或

我们常说的抛硬币实验便符合此(0-1)分布。

(二)、二项分布

二项分布是n个独立的是/非试验中成功的次数的离散概率分布,其中每次试验的成功概率为p。这样的单次成功/失败试验又称为伯努利试验。举个例子就是,独立重复地抛n次硬币,每次只有两个可能的结果:正面,反面,概率各占1/2。设A在n重贝努利试验中发生X次,则

并称X服从参数为p的二项分布,记为:

与此同时,

(三)、泊松分布(Poisson分布)

若随机变量X的概率分布律为称X服从参数为λ的泊松分布,记为:

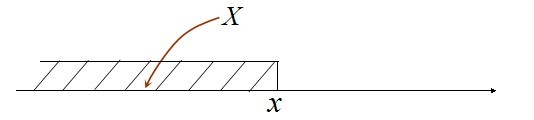

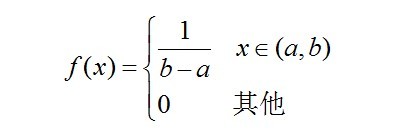

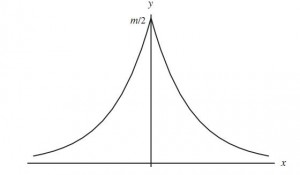

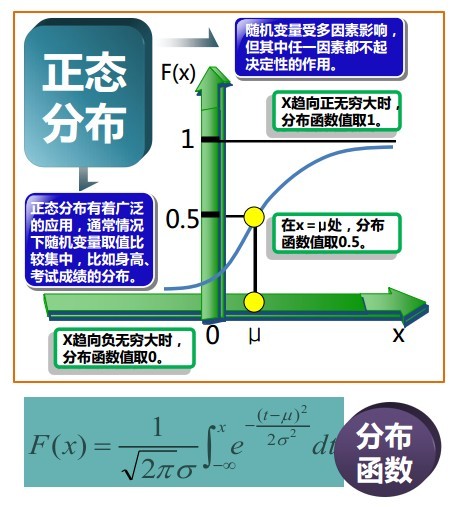

有一点提前说一下,泊松分布中,其数学期望与方差相等,都为参数λ。 2.2.2、随机变量的分布函数 实际中,对于非离散型随机变量X而言,其所有可能的值一一列举出来,故其也就不能像离散型随机变量那般可以用分布律来描述它,那怎么办呢?既然无法研究其全部,那么我们可以转而去研究随机变量所取的值在一个区间(x1,x2] 的概率:P{x1 < X <=x2 },同时注意P{x1 < X <=x2 } = P{X <=x2} - P{X <=x1},故要求P{x1 < X <=x2 } ,我们只需求出P{X <=x2} 和 P{X <=x1} 即可。 针对随机变量X,对应变量x,则P(X<=x) 应为x的函数。如此,便引出了分布函数的定义。 定义:随机变量X,对任意实数x,称函数F(x) = P(X <=x ) 为X 的概率分布函数,简称分布函数。 F(x)的几何意义如下图所示:

且对于任意实数x1,x2(x1<x2),有P{x1<X<=x2} = P{X <=x2} - P{X <= x1} = F(x2) - F(x1)。 同时,F(X)有以下几点性质:

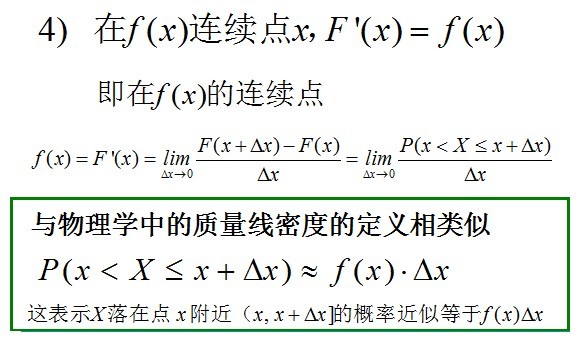

2.2.3、连续型随机变量及其概率密度 定义:对于随机变量X的分布函数F(x),若存在非负的函数f(x),使对于任意实数x,有:

则称X为连续型随机变量,其中f(x)称为X的概率密度函数,简称概率密度。f(x)的性质如下图所示:

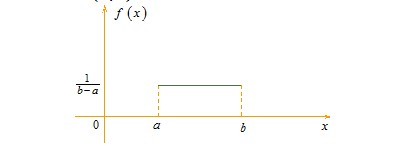

接下来,介绍三种连续型随机变量的分布,由于均匀分布及指数分布比较简单,所以,一图以概之,下文会重点介绍正态分布。(一)、均匀分布 若连续型随机变量X具有概率密度

则称X 在区间(a,b)上服从均匀分布,记为X~U(a,b)。

易知,f(x) >= 0,且其期望值为(a + b)/ 2。(二)、指数分布 若连续型随机变量X 的概率密度为

其中λ>0为常数,则称X服从参数为λ的指数分布。记为

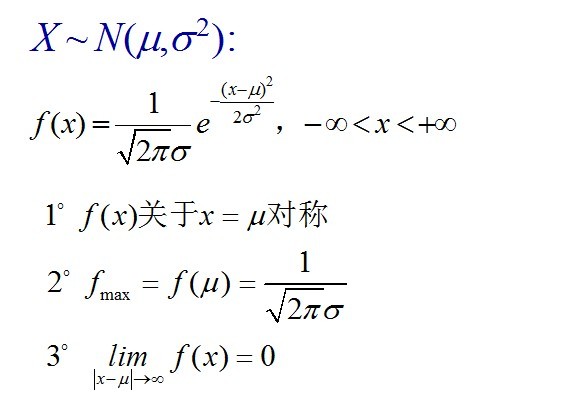

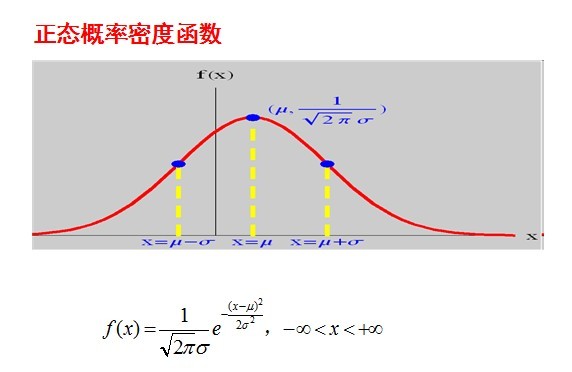

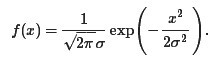

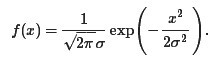

(三)、正态分布 在各种公式纷至沓来之前,我先说一句:正态分布没有你想的那么神秘,它无非是研究误差分布的一个理论,因为实践过程中,测量值和真实值总是存在一定的差异,这个不可避免的差异即误差,而误差的出现或者分布是有规律的,而正态分布不过就是研究误差的分布规律的一个理论。 OK,若随机变量

服从一个位置参数为

服从一个位置参数为 、尺度参数为

、尺度参数为 的概率分布,记为:

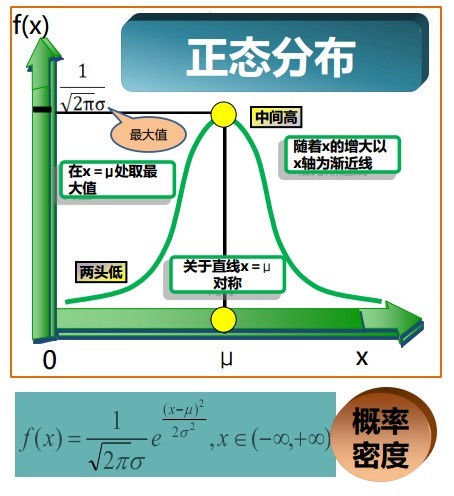

的概率分布,记为: 则其概率密度函数为

我们便称这样的分布为正态分布或高斯分布,记为:

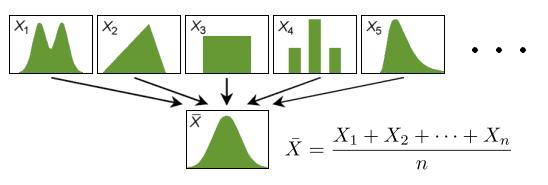

正态分布的数学期望值或期望值等于位置参数

,决定了分布的位置;其方差

,决定了分布的位置;其方差 的开平方,即标准差

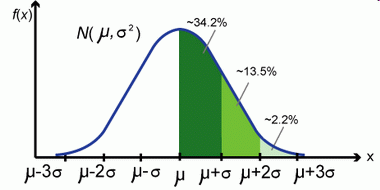

的开平方,即标准差 等于尺度参数,决定了分布的幅度。正态分布的概率密度函数曲线呈钟形,因此人们又经常称之为钟形曲线。它有以下几点性质,如下图所示:

等于尺度参数,决定了分布的幅度。正态分布的概率密度函数曲线呈钟形,因此人们又经常称之为钟形曲线。它有以下几点性质,如下图所示:正态分布的概率密度曲线则如下图所示:

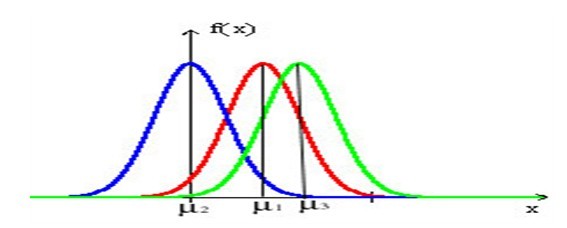

当固定尺度参数

,改变位置参数

,改变位置参数 的大小时,f(x)图形的形状不变,只是沿着x轴作平移变换,如下图所示:

的大小时,f(x)图形的形状不变,只是沿着x轴作平移变换,如下图所示:而当固定位置参数

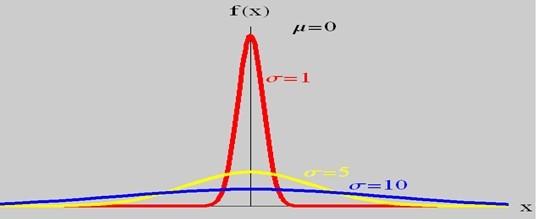

,改变尺度参数

,改变尺度参数 的大小时,f(x)图形的对称轴不变,形状在改变,越小,图形越高越瘦,越大,图形越矮越胖。如下图所示:

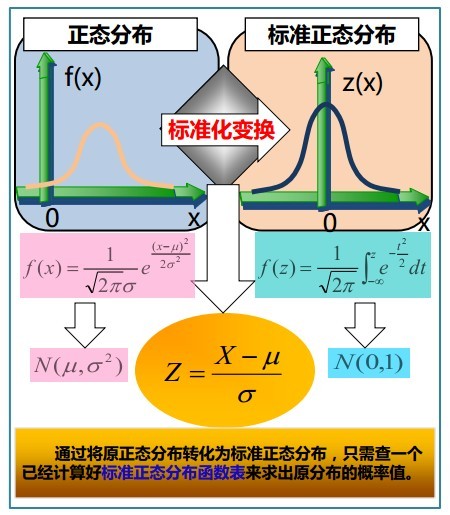

的大小时,f(x)图形的对称轴不变,形状在改变,越小,图形越高越瘦,越大,图形越矮越胖。如下图所示:故有咱们上面的结论,在正态分布中,称μ为位置参数(决定对称轴位置),而 σ为尺度参数(决定曲线分散性)。同时,在自然现象和社会现象中,大量随机变量服从或近似服从正态分布。 而我们通常所说的标准正态分布是位置参数

, 尺度参数

, 尺度参数 的正态分布,记为:

的正态分布,记为:标准正态分布如何由正态分布得来呢?下图可以说明之:

OK,相信,你我可以想象得到,我们现在眼前所看到的正态分布曲线虽然看上去很美,但数学史上任何一个定理的发明几乎都不可能一蹴而就,很多往往经历了几代人的持续努力。因为在科研上诸多观念的革新和突破是有着很多的不易的,或许某个定理在某个时期由某个人点破了,现在的我们看来一切都是理所当然,但在一切没有发现之前,可能许许多多的顶级学者毕其功于一役,耗尽一生,努力了几十年最终也是无功而返。

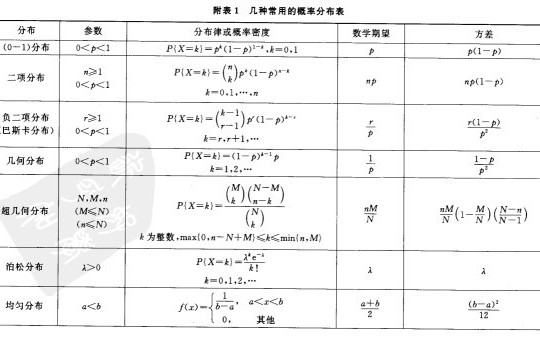

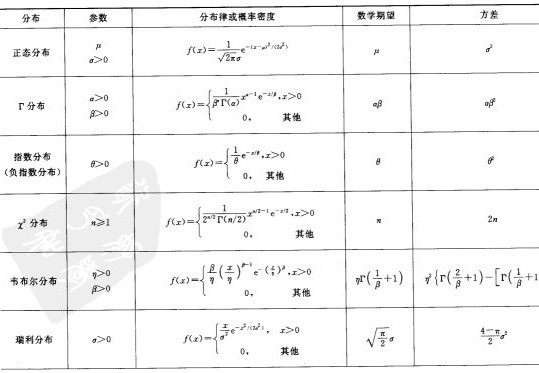

如你所见,现在诸如概率论与数理统计的教材上,一上来介绍正态分布,然后便给出其概率密度分布函数,却从来没有说明这个分布函数是通过什么原理推导出来的。如此,可能会导致你我在内的很多人一直搞不明白数学家当年是怎么找到这个概率分布曲线的,又是怎么发现随机误差服从这个奇妙的分布的。我们在实践中大量的使用正态分布,却对这个分布的来龙去脉知之甚少。 本文第三节将结合陈希儒院士的《数理统计学简史》及“正态分布的前世今生”为你揭开正态分布的神秘面纱。2.2.4、各种分布的比较 上文中,从(0-1)分布,泊松分布,二项分布,讲到了均匀分布,指数分布,正态分布,那这么多分布,其各自的期望.方差(期望方差的概念下文将予以介绍)都是多少呢?虽说,还有不少分布上文尚未介绍,不过在此,提前总结下,如下两图所示(摘自盛骤版的概率论与数理统计一书后的附录中):

本文中,二维.多维随机变量及其分布不再论述。

第三节、从数理统计简史中看正态分布的历史由来

本节将结合数理统计学简史一书,从早期概率论的发展、棣莫弗的二项概率逼近讲到贝叶斯方法、最小二乘法、误差与正态分布等问题,有详有略,其中,重点阐述正态分布的历史由来。

3.1、正态分布的定义 上文中已经给出了正态分布的相关定义,咱们先再来回顾下。如下两图所示(来源:大嘴巴漫谈数据挖掘):

相信,经过上文诸多繁杂公式的轰炸,读者或有些许不耐其烦,咱们接下来讲点有趣的内容:历史。下面,咱们来结合数理统计简史一书,即正态分布的前世今生系列,从古至今论述正态分布的历史由来。

3.2、早期概率论:从萌芽到推测术3.2.1、惠更新的三个关于期望的定理(一)惠更新的论赌博的计算 所谓概率,即指一个事件发生,一种情况出现的可能性大小的数量指标,介于0和1之间,这个概念最初形成于16世纪,说来可能令你意想不到,凡事无绝对,早期很多概率论中的探讨却与掷骰子等当今看来是违法犯罪的赌博活动有着不可分割的联系,可以说,这些赌博活动反而推动了概率论的早期发展。 历史是纷繁多杂的,咱们从惠更斯的机遇的规律一书入手,此人指导过微积分的奠基者之一的莱布尼兹学习数学,与牛顿等人也有交往,终生未婚。如诸多历史上有名的人物一般,他们之所以被后世的人们记住,是因为他们在某一个领域的杰出贡献,这个贡献可能是提出了某一个定理或者公式,换句话来说,就是现今人们口中所说的代表作,一个意思。 而惠更新为当代人们所熟知的应该是他在《摆式时钟或用于时钟上的摆的运动的几何证明》、《摆钟》等论文中提出了物理学史上钟摆摆动周期的公式:

。 (二)创立数学期望 与此同时,惠更斯1657年发表了《论赌博中的计算》,被认为是概率论诞生的标志。同时对二次曲线、复杂曲线、悬链线、曳物线、对数螺线等平面曲线都有所研究。 《论赌博中的计算》中,惠更斯先从关于公平赌博值的一条公理出发,推导出有关数学期望的三个基本定理,如下述内容所示:

。 (二)创立数学期望 与此同时,惠更斯1657年发表了《论赌博中的计算》,被认为是概率论诞生的标志。同时对二次曲线、复杂曲线、悬链线、曳物线、对数螺线等平面曲线都有所研究。 《论赌博中的计算》中,惠更斯先从关于公平赌博值的一条公理出发,推导出有关数学期望的三个基本定理,如下述内容所示:公理:每个公平博弈的参与者愿意拿出经过计算的公平赌注冒险而不愿拿出更多的数量。即赌徒愿意押的赌注不大于其获得赌金的数学期望数。 对这一公理至今仍有争议。所谓公平赌注的数额并不清楚,它受许多因素的影响。但惠更斯由此所得关于数学期望的3 个命题具有重要意义。这是数学期望第一次被提出,由于当时概率的概念还不明确,后被拉普拉斯( Laplace ,1749 —1827) 用数学期望来定义古典概率。在概率论的现代表述中,概率是基本概念,数学期望则是二级概念,但在历史发展过程中却顺序相反。

关于数学期望的三个命题为:

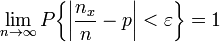

命题1 若在赌博中获得赌金a 和b 的概率相等,则其数学期望值为( a + b)/2;命题2 若在赌博中获得赌金a 、b 和c 的概率相等,则其数学期望值为( a + b + c)/3;命题3 若在赌博中分别以概率p 和q ( p ≥0 , q ≥0 , p + q = 1) 获得赌金a 和b ,则获得赌金的数学期望值为pa + qb。 这些今天看来都可作为数学期望定义,不准确的说,数学期望来源于取平均值。同时,根据上述惠更斯的3个命题不难证明:若某人在赌博中分别以概率p1...,pk(p1+..+pk=1)分别赢得a1,..ak元,那么其期望为p1a1+...+pkak,这与第一节中关于离散型随机变量的期望的定义完全一致。 但惠更新关于概率论的讨论局限于赌博中,而把概率论由局限于对赌博机遇的讨论扩展出去的则得益于伯努利,他在惠更新的论赌博中的计算一书出版的56年,即1973年出版了划时代的著作:推测术。伯努利在此书中,不仅对惠更斯的关于掷骰子等赌博活动中出现的额各种情况的概率进行了计算,而且还提出了著名的“大数定律”,这个定律在历史上甚至到今天,影响深远,后续诸多的统计方法和理论都是建立在大数定律的基础上。(三) 伯努利的大数定律及其如何而来 同样,咱们在读中学的时候,之所以记住了伯努利这个人,恐怕是因为物理课上,老师所讲的伯努利方程

。事件

。事件定理表明事件发生的频率依概率收敛于事件的概率。定理以严格的数学形式表达了频率的稳定性。就是说当n很大时,事件发生的频率于概率有较大偏差的可能性很小。 这个定理如何而来的呢? 咱们来看一个简单的袋中抽球的模型,袋中有a个白球,b个黑球,则从袋中取出白球的概率为p=a/(a+b),有放回的充袋中抽球N次(每次抽取时保证袋中a+b个球的每一个都有同等机会被抽出),记得抽到的白球的次数为X,然后以X/N 这个值去估计p,这个估计方法至今仍是数理统计学中最基本的方法之一。 伯努利试图证明的是:用X/N 估计p 可以达到事实上的确定性,即:任意给定两个数ε>0和η>0,取足够大的抽取次数N,使得事件

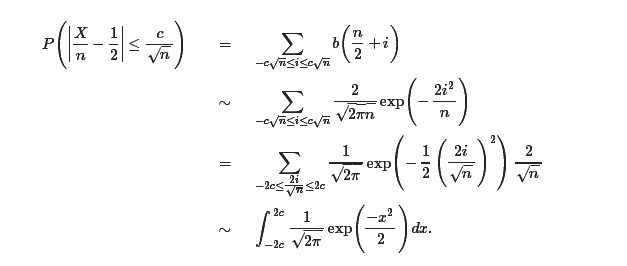

在1733年,棣莫弗发展了用正态分布逼近二项分布的方法。

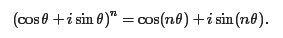

3.3、棣莫弗的二项概率逼近 同上文中的惠更新,伯努利一样,人们熟悉棣莫弗,想必是因为注明的棣莫弗公式,如下:

据数理统计学简史一书上的说明,棣莫弗之所以投身到二项概率的研究,非因伯努利之故,而又是赌博问题(赌博贡献很大丫哈)。有一天一个哥们,也许是个赌徒,向棣莫弗提了一个和赌博相关的一个问题:A,B两人在赌场里赌博,A,B各自的获胜概率是p和q=1?p,赌n局,若A赢的局数X>np,则A付给赌场X?np元,否则B付给赌场np?X元。问赌场挣钱的期望值是多少?按定义可知,此期望值为:

上式的b(N,平,i)为二项概率,棣莫弗最终在Np为整数的条件下得到:

当m=N/2时,N趋于无穷,

也就是说上述问题的本质上是上文第一节中所讲的一个二项分布。虽然从上述公式可以集结此问题,但在N很大时,

棣莫弗后来虽然做了一些计算并得到了一些近似结果,但是还不够,随后有人讲棣莫弗的研究工作告诉给了斯特林,于是,便直接催生了在数学分析中必学的一个重要公式斯特林公式(斯特林公式最初发表于1730年,而后棣莫弗改进了斯特林公式):

1733年,棣莫弗有了一个决定性意义的举动,他证明了当N趋于去穷时,有下列式子成立:(其中,m= N/2)

不要小瞧了这个公式。当它与上面给出的这个公式

根据上面式子,近似地以定积分代替和,得到下式:

不知道,当读者读到这里的时候,是否从上式看出了些许端倪,此式可隐藏了一个我们习以为常却极其重要的概念。OK,或许其形式不够明朗,借用rickjin的式子转化下:

没错,正态分布的概率密度函数在上述的积分公式中出现了,于此,我们得到了一个结论,原来二项分布的极限分布便是正态分布。与此同时,还引出了统计学史上占据重要地位的中心极限定理。 棣莫弗-拉普拉斯定理:设随机变量Xn(n=1,2...)服从参数为p的二项分布,则对任意的x,恒有下式成立:

我们便称此定理为中心极限定理,事实上,中心极限定理还有其它表达形式,下文第4节中会说明。 还没完,最终,在1744年,棣莫弗证明了:

或许,从上面式子,你还没有看出什么蹊跷。但我们可以这样理解:若取c充分大,则对足够大的N,事件

而这就是上文中所讲的伯努利大数定律。我之所以不厌其烦的要论述这个棣莫弗的二项概率逼近的相关过程,是想说明一点:各个定理.公式彼此之前是有着紧密联系的,要善于发现其中的各种联系。 同时,还有一个问题,相信读者已经意识到了,就是咱们的概率论与数理统计教材讲正态分布的时候,一上来便给出正态分布的概率密度函数,然后告诉我们说,符合这个概率密度函数的称为正态分布,紧接着阐述和证明相关性质,最后说了一句:”在自然现象和社会现象中,大量随机变量都服从或近似服从正态分布,如人的身高,某零件长度的误差,海洋波浪的高度“,然后呢?然后什么也没说了。连正态分布中最基本的两个参数为

、和

、和 的的意义都不告诉我们(位置参数

的的意义都不告诉我们(位置参数 即为数学期望,尺度参数为

即为数学期望,尺度参数为 即为方差)。 随后,教材上便开始讲数学期望,方差等概念,最后才讲到中心极限定理。或许在读者阅读本文之前,这些定理的先后发明顺序才得以知晓。如rickjin所言:’‘学家研究数学问题的进程很少是按照我们数学课本的安排顺序推进的,现代的数学课本都是按照数学内在的逻辑进行组织编排的,虽然逻辑结构上严谨优美,却把数学问题研究的历史痕迹抹得一干二净。DNA双螺旋结构的发现者之一James Waston在他的名著《DNA双螺旋》序言中说:“科学的发现很少会像门外汉所想象的一样,按照直接了当合乎逻辑的方式进行的。’’‘「注:本3.3小节主要整编自数理统计简史,参考rickjin所写的正态分布的前世今生系列」

即为方差)。 随后,教材上便开始讲数学期望,方差等概念,最后才讲到中心极限定理。或许在读者阅读本文之前,这些定理的先后发明顺序才得以知晓。如rickjin所言:’‘学家研究数学问题的进程很少是按照我们数学课本的安排顺序推进的,现代的数学课本都是按照数学内在的逻辑进行组织编排的,虽然逻辑结构上严谨优美,却把数学问题研究的历史痕迹抹得一干二净。DNA双螺旋结构的发现者之一James Waston在他的名著《DNA双螺旋》序言中说:“科学的发现很少会像门外汉所想象的一样,按照直接了当合乎逻辑的方式进行的。’’‘「注:本3.3小节主要整编自数理统计简史,参考rickjin所写的正态分布的前世今生系列」3.4、贝叶斯方法 前面,介绍了惠更斯、伯努利和棣莫弗等人的重大成果,无疑在这些重要发明中,二项分布都占据着举重轻重的地位。这在早期的概率统计史当中,也是唯一一个研究程度很深的分布。但除了伯努利的大数定律及棣莫弗的二项逼近的研究成果外,在18世纪中叶,为了解决二项分布概率的估计问题,出现了一个影响极为广泛的贝叶斯方法,贝叶斯方法经过长足的发展,如今已经成为数理统计学中的两个主要学派之一:贝叶斯学派,牢牢占据数理统计学领域的半壁江山。 据数理统计学简史一书,托马斯.贝叶斯,此人在18世纪上半叶的欧洲学术界,并不算得上很知名,在提出贝叶斯定理之前,也未发表过片纸只字的科学论著,套用当今的话来说,他便是活生生一个民间学术丝。

未发表过任何科学著作,但一个人如果热爱研究,喜好学术的话,必找人交流。于此,诸多重大发明定理都出现在学者之间的一些书信交流中。奇怪的是,贝叶斯这方面的书信材料也不多。或许读者读到此处,已知我意,会说这一切在他提出贝叶斯定理之后有了改变,但读者朋友只猜对了一半。 贝叶斯的确发表了一篇题为An essay towards solving a problem in the doctrine of chances(机遇理论中一个问题的解)的遗作,此文在他发表后很长一段时间起,在学术界没有引起什么反响,直到20世纪以来,突然受到人们的重视,此文也因此成为贝叶斯学派最初的奠基石(又一个梵高式的人物)。 有人说贝叶斯发表此文的动机是为了解决伯努利和棣莫弗未能解决的二项分布概率P的“逆概率”问题。所谓逆概率,顾名思义,就是求概率问题的逆问题:已知时间的概率为P,可由之计算某种观察结果的概率如何;反过来,给定了观察结果,问由之可以对概率P作何推断。也就是说,正概率是由原因推结果,称之为概率论;而逆概率是结果推原因,称之为数理统计。 由于本文中,重点不在贝叶斯定理,且此文从决策树学习谈到贝叶斯分类算法、EM、HMM第二部分也详细介绍过了贝叶斯方法,故为本文篇幅所限,不再做过多描述。

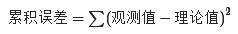

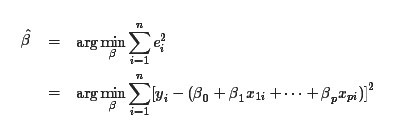

3.5、最小二乘法,数据分析的瑞士军刀 事实上,在成百上千的各式各样的攻击方法中,取算术平均恐怕是最广为人知使用也最为广泛的方法,因为可能一个小学生都知道使用算术平均来计算自己每天平均花了多少零花钱而以此作为向爸妈讨要零花钱的依据。而我们大多数成年人也经常把“平均说来”挂在嘴边。故此节要讲的最小二乘法其实并不高深,它的本质思想即是来源于此算术平均的方法。 不太精确的说,一部数理统计学的历史,就是从纵横两个方向对算术平均进行不断深入研究的历史,纵的方面指平均值本身,诸如伯努利及其后众多的大数定律,棣莫弗-拉普拉斯中心极限定理,高斯的正太误差理论,这些在很大程度上都可以视为对算术平均的研究成果,甚至到方差,标准差等概念也是由平均值发展而来;横的方面中最为典型的就是此最小二乘法。 而算术平均也是解释最小二乘法的最简单的例子。使误差平方和达到最小以寻求估计值的方法,则称为最小二乘估计(当然,取平方和作为目标函数知识众多可取的方法之一,例如也可以去误差4次方或绝对值和,取平方和是人类千百年实践中被证实行之有效的方法,因此被普遍采用)。 何谓最小二乘法?实践中,常需寻找两变量之间的函数关系,比如测定一个刀具的磨损速度,也就是说,随着使用刀具的次数越多,刀具本身的厚度会逐渐减少,故刀具厚度与使用时间将成线性关系,假设符合f(t)=at + b(t代表时间,f(t)代表刀具本身厚度),a,b是待确定的常数,那么a、b如何确定呢? 最理想的情形就是选取这样的a、b,能使直线y = at + b 所得到的值与实际中测量到的刀具厚度完全符合,但实际上这是不可能的,因为误差总是存在难以避免的。故因误差的存在,使得理论值与真实值存在偏差,为使偏差最小通过偏差的平方和最小确定系数a、b,从而确定两变量之间的函数关系f(t)= at + b。 这种通过偏差的平方和为最小的条件来确定常数a、b的方法,即为最小二乘法。最小二乘法的一般形式可表述为:

相信读者已经看出,最小二乘法之所以与统计学有着密切的联系,因为观测值有随机误差,所以它同正态分布一样与误差论有着密切联系。 那么,最小二乘法是如何发明的呢?据史料记载,最小二乘法最初是由法国数学家勒让德于1805年发明的。那勒让德发明它的动机来源于哪呢? 18世纪中叶,包括勒让德、欧拉、拉普拉斯、高斯在内的许多天文学家和数学家都对天文学上诸多问题的研究产生了浓厚的兴趣。比如以下问题:土星和木星是太阳系中的大行星,由于相互吸引对各自的运动轨道产生了影响,许多大数学家,包括欧拉和拉普拉斯都在基于长期积累的天文观测数据计算土星和木星的运行轨道。勒让德承担了一个政府给的重要任务,测量通过巴黎的子午线的长度。海上航行经纬度的定位。主要是通过对恒星和月面上的一些定点的观测来确定经纬度。

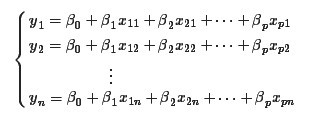

这些问题都可以用如下数学模型描述:我们想估计的量是β0,?,βp,另有若干个可以测量的量x1,?,xp,y,这些量之间有线性关系

如何通过多组观测数据求解出参数β0,?,βp呢?欧拉和拉普拉斯采用的都是求解线性方程组的方法。

但是面临的一个问题是,有n组观测数据,p+1个变量,如果n>p+1,则得到的线性矛盾方程组,无法直接求解。所以欧拉和拉普拉斯采用的方法都是通过一定的对数据的观察,把n个线性方程分为p+1组,然后把每个组内的方程线性求和后归并为一个方程,从而就把n个方程的方程组化为p+1个方程的方程组,进一步解方程求解参数。这些方法初看有一些道理,但是都过于经验化,无法形成统一处理这一类问题的一个通用解决框架。

以上求解线性矛盾方程的问题在现在的本科生看来都不困难,就是统计学中的线性回归问题,直接用最小二乘法就解决了,可是即便如欧拉、拉普拉斯这些数学大牛,当时也未能对这些问题提出有效的解决方案。可见在科学研究中,要想在观念上有所突破并不容易。有效的最小二乘法是勒让德在1805年发表的,基本思想就是认为测量中有误差,所以所有方程的累积误差为:

我们求解出导致累积误差最小的参数即可。

上面我们已经看到,是勒让德最初发明的最小二乘法,那为何历史上人们常常把最小二乘法的发明与高斯的名字联系起来呢?这是因为在1829年,高斯提供了最小二乘法的优化效果强于其他方法的证明,即为高斯-马尔可夫定理。也就是说勒让德最初提出了最小二乘法,而却是高斯让最小二乘法得以巩固而影响至今。且高斯对最小二乘法的最大贡献在于他是建立在正太误差分布的理论基础之上的。 包括拉普拉斯用他的中心极限定理定理也可以推导出最小二乘法。可能这些说的还是含糊其辞,说白了,就是诸多问题包括本节所讲的最小二乘法中,这个观测值与理论值的误差服从正态分布。高斯后续也导出了误差服从正态分布的结论「注:本3.5小节主要整编自数理统计简史及rickjin所写的正态分布的前世今生系列」。

3.6、误差分布曲线的建立 十八世纪,天文学的发展积累了大量的天文学数据需要分析计算,应该如何来处理数据中的观测误差成为一个很棘手的问题。我们在数据处理中经常使用平均的常识性法则,千百年来的数据使用经验说明算术平均能够消除误差,提高精度。平均有如此的魅力,道理何在,之前没有人做过理论上的证明。算术平均的合理性问题在天文学的数据分析工作中被提出来讨论:测量中的随机误差服应该服从怎样的概率分布?算术平均的优良性和误差的分布有怎样的密切联系? 伽利略在他著名的《关于两个主要世界系统的对话》中,对误差的分布做过一些定性的描述,主要包括:

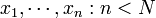

误差是对称分布的;大的误差出现频率低,小的误差出现频率高。 用数学的语言描述,也就是说误差分布函数f(x)关于0对称分布,概率密度随|x|增加而减小,这两个定性的描述都很符合常识。3.6.1、辛普森的工作 许多天文学家和数学家开始了寻找误差分布曲线的尝试。托马斯?辛普森(Thomas Simpson,1710-1761)先走出了有意义的一步。设真值为θ,而

为n次测量值,现在用测量值

为n次测量值,现在用测量值 去估计真值

去估计真值 ,那么每次测量的误差为

,那么每次测量的误差为 去估计θ呢,则其误差为

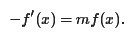

去估计θ呢,则其误差为 。Simpson证明了,对于如下的一个概率分布,

。Simpson证明了,对于如下的一个概率分布,Simpson的误差态分布曲线 有这样的估计:

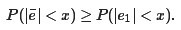

也就是说,

也就是说, 去估计真值

去估计真值 。 拉普拉斯假定误差密度函数f(x)满足如下性质:

。 拉普拉斯假定误差密度函数f(x)满足如下性质:由此最终求得的分布密度函数为:

这个概率密度函数现在被称为拉普拉斯分布:

以这个函数作为误差密度,拉普拉斯开始考虑如何基于测量的结果去估计未知参数的值,即用什么方法通过观测值

去估计真值

去估计真值 呢?要知道咱们现今所熟知的所谓点估计方法、矩估计方法,包括所谓的极大似然估计法之类的,当时可是都还没有发明。 拉普拉斯可以算是一个贝叶斯主义者,他的参数估计的原则和现代贝叶斯方法非常相似:假设先验分布是均匀的,计算出参数的后验分布后,取后验分布的中值点,即1/2分位点,作为参数估计值。可是基于这个误差分布函数做了一些计算之后,拉普拉斯发现计算过于复杂,最终没能给出什么有用的结果,故拉普拉斯最终还是没能搞定误差分布的问题。 至此,整个18世纪,可以说,寻找误差分布的问题,依旧进展甚微,下面,便将轮到高斯出场了,历史总是出人意料,高斯以及其简单的手法,给了这个误差分布的问题一个圆满的解决,其结果也就成为了数理统计发展史上的一块重要的里程碑。3.6.3、高斯导出误差正态分布 事实上,棣莫弗早在1730年~1733年间便已从二项分布逼近的途径得到了正态密度函数的形式,到了1780年后,拉普拉斯也推出了中心极限定理的一般形式,但无论是棣莫弗,还是拉普拉斯,此时他们这些研究成果都还只是一个数学表达式而非概率分布,而只有到了1809年,高斯提出“正太误差”的理论之后,它正太理论才得以“概率分布“的身份进入科学殿堂,从而引起人们的重视。 追本溯源,正态分布理论这条大河的源头归根结底是测量误差理论。那高斯到底在正态分布的确立做了哪些贡献呢?请看下文。 1801年1月,天文学家Giuseppe Piazzi发现了一颗从未见过的光度8等的星在移动,这颗现在被称作谷神星(Ceres)的小行星在夜空中出现6个星期,扫过八度角后在就在太阳的光芒下没了踪影,无法观测。而留下的观测数据有限,难以计算出他的轨道,天文学家也因此无法确定这颗新星是彗星还是行星,这个问题很快成了学术界关注的焦点。高斯当时已经是很有名望的年轻数学家了,这个问题也引起了他的兴趣。高斯一个小时之内就计算出了行星的轨道,并预言了它在夜空中出现的时间和位置。1801年12月31日夜,德国天文爱好者奥伯斯(Heinrich Olbers)在高斯预言的时间里,用望远镜对准了这片天空。果然不出所料,谷神星出现了!

呢?要知道咱们现今所熟知的所谓点估计方法、矩估计方法,包括所谓的极大似然估计法之类的,当时可是都还没有发明。 拉普拉斯可以算是一个贝叶斯主义者,他的参数估计的原则和现代贝叶斯方法非常相似:假设先验分布是均匀的,计算出参数的后验分布后,取后验分布的中值点,即1/2分位点,作为参数估计值。可是基于这个误差分布函数做了一些计算之后,拉普拉斯发现计算过于复杂,最终没能给出什么有用的结果,故拉普拉斯最终还是没能搞定误差分布的问题。 至此,整个18世纪,可以说,寻找误差分布的问题,依旧进展甚微,下面,便将轮到高斯出场了,历史总是出人意料,高斯以及其简单的手法,给了这个误差分布的问题一个圆满的解决,其结果也就成为了数理统计发展史上的一块重要的里程碑。3.6.3、高斯导出误差正态分布 事实上,棣莫弗早在1730年~1733年间便已从二项分布逼近的途径得到了正态密度函数的形式,到了1780年后,拉普拉斯也推出了中心极限定理的一般形式,但无论是棣莫弗,还是拉普拉斯,此时他们这些研究成果都还只是一个数学表达式而非概率分布,而只有到了1809年,高斯提出“正太误差”的理论之后,它正太理论才得以“概率分布“的身份进入科学殿堂,从而引起人们的重视。 追本溯源,正态分布理论这条大河的源头归根结底是测量误差理论。那高斯到底在正态分布的确立做了哪些贡献呢?请看下文。 1801年1月,天文学家Giuseppe Piazzi发现了一颗从未见过的光度8等的星在移动,这颗现在被称作谷神星(Ceres)的小行星在夜空中出现6个星期,扫过八度角后在就在太阳的光芒下没了踪影,无法观测。而留下的观测数据有限,难以计算出他的轨道,天文学家也因此无法确定这颗新星是彗星还是行星,这个问题很快成了学术界关注的焦点。高斯当时已经是很有名望的年轻数学家了,这个问题也引起了他的兴趣。高斯一个小时之内就计算出了行星的轨道,并预言了它在夜空中出现的时间和位置。1801年12月31日夜,德国天文爱好者奥伯斯(Heinrich Olbers)在高斯预言的时间里,用望远镜对准了这片天空。果然不出所料,谷神星出现了!高斯为此名声大震,但是高斯当时拒绝透露计算轨道的方法直到1809年高斯系统地完善了相关的数学理论后,才将他的方法公布于众,而其中使用的数据分析方法,就是以正态误差分布为基础的最小二乘法。那高斯是如何推导出误差分布为正态分布的呢?请看下文。

跟上面一样,还是设真值为

,而

,而 为n次独立测量值,每次测量的误差为

为n次独立测量值,每次测量的误差为到此为止,高斯的作法实际上与拉普拉斯相同,但在继续往下进行时,高斯提出了两个创新的想法。 第一个创新的想法便是:高斯并没有像前面的拉普拉斯那样采用贝叶斯的推理方式,而是直接取L(θ)达到最小值的

作为

作为 的估计值,这也恰恰是他解决此问题采用的创新方法,即

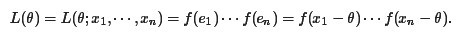

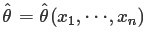

的估计值,这也恰恰是他解决此问题采用的创新方法,即现在我们把L(θ)称为样本的似然函数,而得到的估计值θ?称为极大似然估计。高斯首次给出了极大似然的思想,这个思想后来被统计学家R.A.Fisher系统地发展成为参数估计中的极大似然估计理论。

高斯的第二点创新的想法是:他把整个问题的思考模式倒过来:既然千百年来大家都认为算术平均是一个好的估计,那么就直接先承认算术平均就是极大似然估计(换言之,极大似然估计导出的就应该是算术平均),所以高斯猜测:

然后高斯再去寻找相应的误差密度函数

以迎合这一点。即寻找这样的概率分布函数

以迎合这一点。即寻找这样的概率分布函数 ,使得极大似然估计正好是算术平均

,使得极大似然估计正好是算术平均 。通过应用数学技巧求解这个函数f,高斯证明了所有的概率密度函数中,唯一满足这个性质的就是(记为(11)式):

。通过应用数学技巧求解这个函数f,高斯证明了所有的概率密度函数中,唯一满足这个性质的就是(记为(11)式):而这恰巧是我们所熟知的正态分布的密度函数

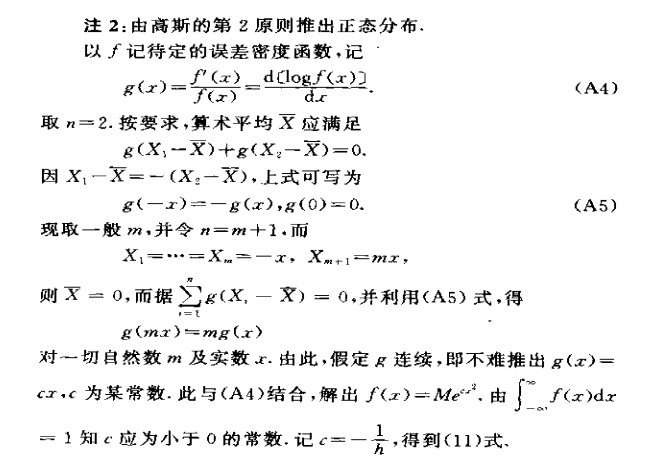

,就这样,误差的正态分布就被高斯给推导出来了! 但,高斯是如何证明的呢?也就是说,高斯是如何一下子就把上面(11)式所述的概率密度函数给找出来的呢?如下图所示(摘自数理统计学简史第127页注2,图中开头所说的高斯的第2原则就是上面所讲的高斯的第二点创新的想法,而图最后所说的(11)式就是上面推导出来的概率密度函数):

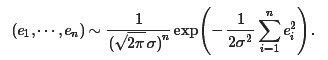

,就这样,误差的正态分布就被高斯给推导出来了! 但,高斯是如何证明的呢?也就是说,高斯是如何一下子就把上面(11)式所述的概率密度函数给找出来的呢?如下图所示(摘自数理统计学简史第127页注2,图中开头所说的高斯的第2原则就是上面所讲的高斯的第二点创新的想法,而图最后所说的(11)式就是上面推导出来的概率密度函数):进一步,高斯基于这个误差分布函数对最小二乘法给出了一个很漂亮的解释。对于最小二乘公式中涉及的每个误差ei,有

,则结合高斯的第一个创新方法:极大似然估计及上述的概率密度,(e1,?,en)的联合概率分布为

,则结合高斯的第一个创新方法:极大似然估计及上述的概率密度,(e1,?,en)的联合概率分布为要使得这个概率最大,必须使得

取最小值,这正好就是最小二乘法的要求。 高斯的这项工作对后世的影响极大,它使正态分布同时有了”高斯分布“的名称,不止如此,后世甚至也把最小二乘法的发明权也归功于他,由于他的这一系列突出贡献,人们采取了各种形式纪念他,如现今德国10马克的钞票上便印有这高斯头像及正态分布的密度曲线

取最小值,这正好就是最小二乘法的要求。 高斯的这项工作对后世的影响极大,它使正态分布同时有了”高斯分布“的名称,不止如此,后世甚至也把最小二乘法的发明权也归功于他,由于他的这一系列突出贡献,人们采取了各种形式纪念他,如现今德国10马克的钞票上便印有这高斯头像及正态分布的密度曲线至此,咱们来总结下:

- 如你所见,相比于勒让德1805给出的最小二乘法描述,高斯基于误差正态分布的最小二乘理论显然更高一筹,高斯的工作中既提出了极大似然估计的思想,又解决了误差的概率密度分布的问题,由此我们可以对误差大小的影响进行统计度量了。但事情就完了么?没有。高斯设定了准则“最大似然估计应该导出优良的算术平均”,并导出了误差服从正态分布,推导的形式上非常简洁优美。但是高斯给的准则在逻辑上并不足以让人完全信服,因为算术平均的优良性当时更多的是一个经验直觉,缺乏严格的理论支持。高斯的推导存在循环论证的味道:因为算术平均是优良的,推出误差必须服从正态分布;反过来,又基于正态分布推导出最小二乘和算术平均,来说明最小二乘法和算术平均的优良性,故其中无论正反论点都必须借助另一方论点作为其出发点,可是算术平均到并没有自行成立的理由。

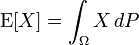

第四节、从数学期望、方差、协方差到中心极限定理4.1、数学期望、方差、协方差4.1.1、数学期望 如果X是在概率空间(Ω, P)中的一个随机变量,那么它的期望值E[X]的定义是:

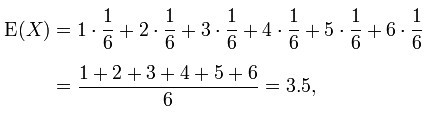

并不是每一个随机变量都有期望值的,因为有的时候这个积分不存在。如果两个随机变量的分布相同,则它们的期望值也相同。 在概率论和统计学中,数学期望分两种(依照上文第二节相关内容也可以得出),一种为离散型随机变量的期望值,一种为连续型随机变量的期望值。 一个离散性随机变量的期望值(或数学期望、或均值,亦简称期望)是试验中每次可能结果的概率乘以其结果的总和。换句话说,期望值是随机试验在同样的机会下重复多次的结果计算出的等同“期望”的平均值。 例如,掷一枚六面骰子,得到每一面的概率都为1/6,故其的期望值是3.5,计算如下:

承上,如果X 是一个离散的随机变量,输出值为x1, x2, ..., 和输出值相应的概率为p1, p2, ...(概率和为1),若级数

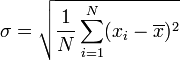

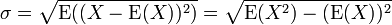

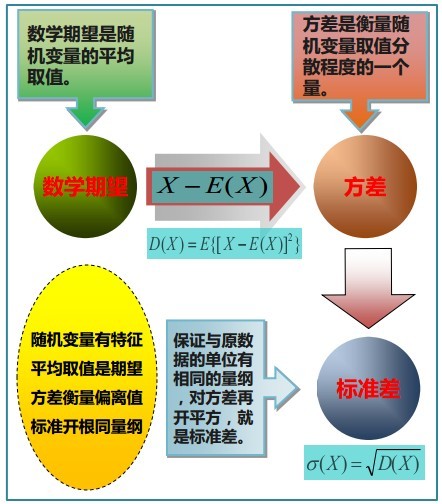

实际上,此连续随机型变量的期望值的求法与离散随机变量的期望值的算法同出一辙,由于输出值是连续的,只不过是把求和改成了积分。4.1.2、方差与标准差方差 在概率论和统计学中,一个随机变量的方差(Variance)描述的是它的离散程度,也就是该变量离其期望值的距离。一个实随机变量的方差也称为它的二阶矩或二阶中心动差,恰巧也是它的二阶累积量。方差的算术平方根称为该随机变量的标准差。 其定义为:如果

其中,

简单来说,标准差是一组数值自平均值分散开来的程度的一种测量观念。一个较大的标准差,代表大部分的数值和其平均值之间差异较大;一个较小的标准差,代表这些数值较接近平均值。例如,两组数的集合 {0, 5, 9, 14} 和 {5, 6, 8, 9} 其平均值都是 7 ,但第二个集合具有较小的标准差。 前面说过,方差的算术平方根称为该随机变量的标准差,故一随机变量的标准差定义为:

为

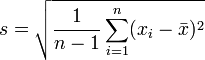

为 具有相同概率,则可用上述公式计算标准差。 样本标准差 在真实世界中,除非在某些特殊情况下,找到一个总体的真实的标准差是不现实的。大多数情况下,总体标准差是通过随机抽取一定量的样本并计算样本标准差估计的。说白了,就是数据海量,想计算总体海量数据的标准差无异于大海捞针,那咋办呢?抽取其中作为抽样代表呗。 而从一大组数值

具有相同概率,则可用上述公式计算标准差。 样本标准差 在真实世界中,除非在某些特殊情况下,找到一个总体的真实的标准差是不现实的。大多数情况下,总体标准差是通过随机抽取一定量的样本并计算样本标准差估计的。说白了,就是数据海量,想计算总体海量数据的标准差无异于大海捞针,那咋办呢?抽取其中作为抽样代表呗。 而从一大组数值

,进而,我们可以定义其样本标准差为:

,进而,我们可以定义其样本标准差为:样本方差

是对总体方差

是对总体方差

的无偏估计。

的无偏估计。  中分母为 n-1 是因为

中分母为 n-1 是因为 的自由度为n-1(且慢,何谓自由度?简单说来,即指样本中的n个数都是相互独立的,从其中抽出任何一个数都不影响其他数据,所以自由度就是估计总体参数时独立数据的数目,而平均数是根据n个独立数据来估计的,因此自由度为n),这是由于存在约束条件

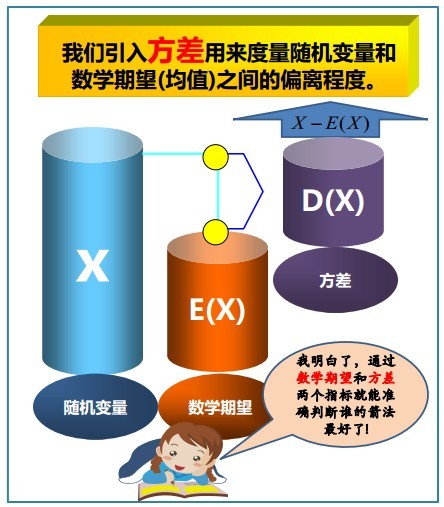

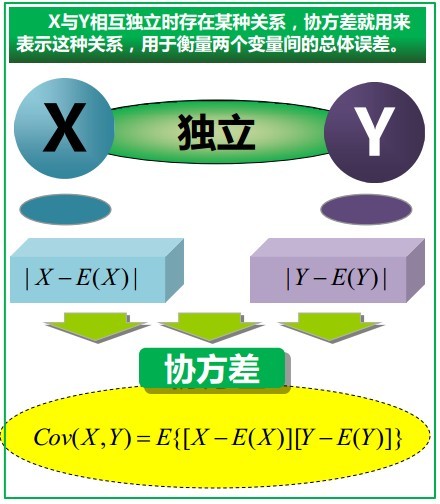

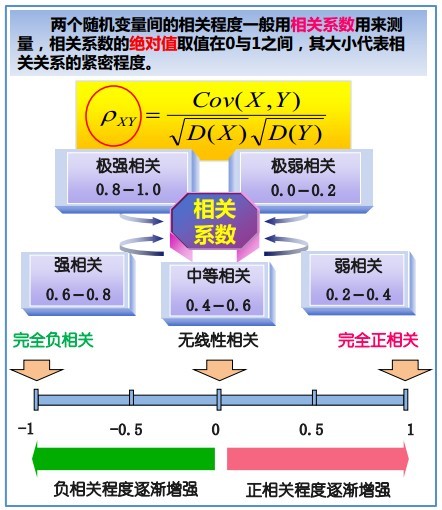

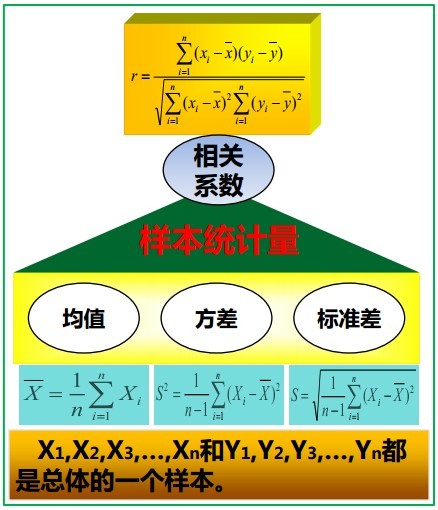

的自由度为n-1(且慢,何谓自由度?简单说来,即指样本中的n个数都是相互独立的,从其中抽出任何一个数都不影响其他数据,所以自由度就是估计总体参数时独立数据的数目,而平均数是根据n个独立数据来估计的,因此自由度为n),这是由于存在约束条件待续.. 一下子又要接受这么多纷杂不堪的概念,咋办,直接上图巩固下上述期望,方差,协方差的概念吧(来源:大嘴巴满谈数据挖掘):

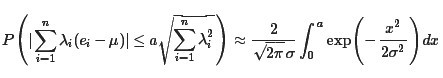

4.2、中心极限定理 先来说说正态分布在概率论中的地位,这个主要是由于中心极限定理的影响。1776年,拉普拉斯开始考虑一个天文学中的彗星轨道的倾角的计算问题,最终的问题涉及独立随机变量求和的概率计算,也就是计算如下的概率值

令 Sn=X1+X2+?+Xn, 那么

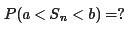

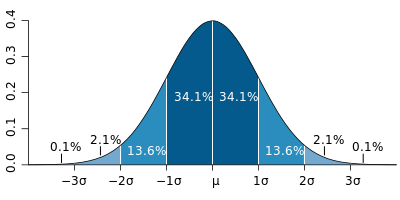

在这个问题的处理上,拉普拉斯充分展示了其深厚的数学分析功底和高超的概率计算技巧,他首次引入了特征函数(也就是对概率密度函数做傅立叶变换)来处理概率分布的神妙方法,而这一方法经过几代概率学家的发展,在现代概率论里面占有极其重要的位置。基于这一分析方法,拉普拉斯通过近似计算,在他的1812年的名著《概率分析理论》中给出了中心极限定理的一般描述:[定理Laplace,1812]设 ei(i=1,?n)为独立同分布的测量误差,具有均值μ和方差σ2。如果λ1,?,λn为常数,a>0,则有

这已经是比棣莫弗-拉普拉斯中心极限定理更加深刻的一个结论了,在现在大学本科的教材上,包括包括本文主要参考之一盛骤版的概率论与数理统计上,通常给出的是中心极限定理的一般形式: [Lindeberg-Levy中心极限定理] 设X1,?,Xn独立同分布,且具有有限的均值μ和方差σ2,则在n→∞时,有

多么奇妙的性质,随意的一个概率分布中生成的随机变量,在序列和(或者等价的求算术平均)的操作之下,表现出如此一致的行为,统一的规约到正态分布。

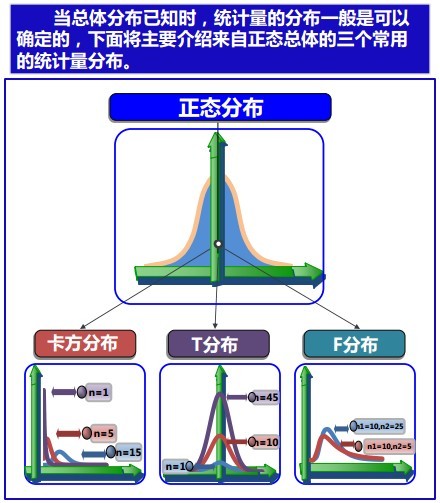

在正态分布、中心极限定理的确立之下,20世纪之后,统计学三大分布χ2分布、t分布、F分布也逐步登上历史舞台:

待续..

别看上文已经花了如此多的篇幅讲了那么多的概念,而事实上,在概率论与数理统计中,上文所讲的概念尚不到1/3,限于篇幅,还有诸多概念没有阐述完毕(放于数据挖掘中所需的概率论与数理统计知识、下中介绍),如下图所示:

OK,如上,之前微博上http://weibo.com/1580904460/z9htU9VzT 说要写的概率论与数理统计的科普blog、上部分已经初步整理完成(当然,后续一个星期之内会继续修补完善)。从前天晚上开始,连续写了两天,花了半身力气,文章若有任何问题,欢迎指正,尤能给出批评修订意见,则倍感荣幸,谢谢。.同时,但所有以上这些绝大部分都只是概率论与数理统计的基础知识,因此本文只能作个科普之效,若要深入学习,还是烦请读者朋友们阅读相关书籍,或加以动手实践。

- 高等数学第六版上下册,同济大学数学系编;

微积分概念发展史,[美] 卡尔B波耶 著,唐生 译;概率论与数理统计,高教版,盛骤等编;数理统计学简史,陈希孺院士著;

(极力推荐上书,相信每一个学概率统计的朋友都有必要看一看,同时,此书也是正态分布的前后今生这一系列的主要参考)rickjin,正态分布的前后今生:http://t.cn/zlH3Ygc ;正态分布的前后今生系列集成版上:http://t.cn/zjJStYq,下:http://t.cn/zjoAtUQ;大嘴巴漫谈数据挖掘:http://vdisk.weibo.com/s/bUbzJ;误差论与最小平方法 & 数学传播,蔡聪明;正态分布进入统计学的历史演化,吴江霞;Probability Theory & The Logic of Science (概率论沉思录),E.T. Jaynes 著;

手写数学公式编辑器:http://webdemo.visionobjects.com/equation.html?locale=zh_CN;wikipedia上标准差:http://zh.wikipedia.org/wiki/%E6%A0%87%E5%87%86%E5%B7%AE;wikipedia上一堆概念;....

后记 本文之后,待写的几篇文章罗列如下,具体完成时间全部待定:

- 机器学习中相关的降维方法,如PCA/LDA等等;神经网络入门学习导论;程序员编程艺术第二十八章;数据挖掘所需的概率论与数理统计知识、下;..

- 24楼xuqianghit10小时前

- 期待下面的博文

- 23楼zhouziting10小时前

- 单纯码农的进阶,要么有管理能力,要么有数学统计功底

- 22楼masikkk昨天 21:27

- 专业啊

- 21楼mljlover昨天 21:21

- 毕业半年不到,这数理统计与概率忘的也差不多了。现在看到博主的这篇文章,又有种大学考试前的感觉了。博主继续,支持!

- 20楼hcit_ld昨天 21:18

- 一直关注楼主,晓得楼主是个牛逼任务,感慨,鄙人合适能赶上君之神威啊!

- 19楼nadia_yin昨天 20:14

- 如果要做算法,数学是基础!楼主有毅力!

- 18楼dyf2886136昨天 19:40

- 还是不清楚高斯怎么一下子就把那个正态分布密度函数找出来了,期待后续文章

- Re: v_JULY_v昨天 19:47

- 回复dyf2886136n哈哈,你这个问题问的很及时,刚好原文正在补充,你现在可以再刷新查看下。

- 17楼duanml61昨天 19:09

- 细读上面的基础概念整理之后发现我的基础知识差很多,临渊羡鱼不如退而结网,回补去了。

- Re: v_JULY_v昨天 19:15

- 回复duanml61nEN,这也是本文的目的,借此机会补补你我的概率论与数理统计等基础知识呢,也不一定非得回去补,我为君慢慢补。

- 16楼yangliuy昨天 15:41

- 顶!对数理统计的公式历史和联系介绍写得很有趣!

- Re: v_JULY_v昨天 17:31

- 回复yangliuyn原文有很多地方可进一步完善,欢迎随时不吝批评指正哈

- 15楼linwaterbin昨天 15:28

- 期待你能把DM十大经典算法实现讲讲

- 14楼l287317761昨天 13:15

- 附上打油诗一首,支持July:天若有情天亦老,人学数学死得早。商女不知忘国恨,隔江犹看概率论。两岸猿声啼不住,互相谈论倾斜度。问君能有几多愁?不定积分不会求。忽如一夜春风来,正交矩阵不会排。风萧萧兮易水寒,各种数学各种难。垂死病中惊坐起,学数学你伤不起!nJuly走你!

- Re: a06062125昨天 13:24

- 回复l287317761n“忽如一夜春风来,正交矩阵不会排。” 说到伤心处了T_T

- Re: v_JULY_v昨天 15:25

- 回复l287317761nGood Job,有才!

- 13楼zhongyijun159昨天 17:59

- 博主数学不错啊。n最近在学数学分析。

- Re: v_JULY_v昨天 18:24

- 回复zhongyijun159n吖,汗颜了,以前的全忘光了,这个月才决心开始恶补数学(相互学习交流)..

- 12楼zhuankeshumo昨天 15:05

- 其实是高中数学知识 只不过高考不是重点 所以就悲催了

- Re: jon_me昨天 15:14

- 回复zhuankeshumon高中那点概率知识少的可怜啊!概率没有高数的支持,没有多大的用法。

- Re: wyjie1987昨天 15:27

- 回复zhuankeshumon现在高中都开始学概率论了???

- Re: zhuankeshumo昨天 16:25

- 回复wyjie1987n嗯 但不是考试重点

- 11楼java43135昨天 13:40

- 记得考研的时候,狠狠的学习了。。。许久不用,又遗忘了好多。

- Re: v_JULY_v昨天 14:22

- 回复java43135n精彩在第二节,在后头哦。

- 10楼qzs_13933908434昨天 13:00

- 刚考完,考的都是疏忽的,悲剧了

- 9楼yang63515074昨天 12:57

- [quote=zhuankeshumo]回复wyjie1987n嗯 但不是考试重点[/quote]nn很好

- 8楼yingzisangongfen昨天 12:39

- 工作了才发现很多知识要重新拾起来啊

- 7楼liulefirst前天 10:34

- 顶个。

- 6楼herer前天 10:23

- 谢谢July。现在我也在补数学,但一直没时间系统性的阅读。你的汇总对我帮助很大,一些不清楚的我再看看后面的参考文献。

- Re: v_JULY_v前天 10:26

- 回复herern具体哪些不清楚你完全可以提出来,我可以立马修补完善原文。

- 5楼wangba_456前天 09:59

- 学技术了

- 4楼Cages前天 09:45

- 支持july 看好你 工作的事情相信你可以找个更好的

- 3楼wangyaohui8888前天 09:43

- 其实概率在数学中理论简单 难得是具体问题的应用 容易算错

- 2楼Moriarty_Xu前天 21:28

- 个人意见,如果每个知识点配一些例子就更好了

- Re: v_JULY_v前天 22:24

- 回复Moriarty_Xun是需要每一个还是重点哪些个?

- Re: Moriarty_Xu前天 08:49

- 回复v_JULY_vn仅是个人意见,如果你的把这篇文章定位为概率统计知识的简介,例子应该可以不用了,我们可以以此为提纲来深入研究

- Re: v_JULY_v前天 09:28

- 回复Moriarty_XunEN,有深有浅,有详有略,本文中一些知识点一直在加以修补完善,逐步扩展深入。

- 1楼beijiguangyong前天 21:27

- 感谢楼主~~

。

。